Ja, min AI ansikt-swap forsøk kan vise hvor vanskelig det er å gjøre en deepfake – men det blir enklere hver dag

@alexhern

Man 12 Mar 2018 06.00 GMT

Sist endret på Mandag 12 mars 2018 06.01 GMT

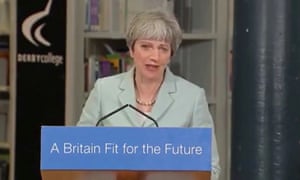

Maggie Kan … men min Theresa Thatcher falske ser bafflingly lik Victoria Tre.

Foto: Alex Hern i the Guardian

Ministere fra House of Commons gransking falske nyheten ble advarte i forrige uke om en ny AI teknologi som er i ferd med å forandre verden, og ikke til det bedre.

“Vi er raskt å flytte inn i en tid der Russerne, eller hvilken som helst annen motstander, og kan lage våre offentlige tall som sier eller gjør ting som er uverdig eller sterkt etsende for offentlig tillit,” Edward Lucas, senior vice president ved Centre for European Policy Analysis fortalte MPs. “Og vi er ikke eksternt klar for dette.”

Lucas ble snakker om såkalte deepfakes, som han beskrev som “lyd og video som ser ut som og høres ut som den virkelige personen, og sa noe som at personen aldri har”.

Mindre enn tre måneder siden, produsere slike videoer, var en møysommelig prosess som krever en video editor, enorme mengder av referanse-opptak og mange års erfaring. Men i de første månedene av dette året, teknologien har eksplodert i offentlig tilgjengelighet.

Jeg ønsket å teste advarsler av Lucas, og dem som var før ham, for å finne ut hvor nær vi er til denne vidunderlige nye verden. Jeg fant at mens det er sant at det er nå enklere enn noensinne å generere en overbevisende falske video med to ansikter byttet ut, er det fortsatt ikke helt lett.

Ansikt-byttet porno

Vis en nevrale nettverket nok eksempler på ansikter fra to kjendiser, og det vil utvikle sin egen mentale modell av hvordan de ser ut, er i stand til å generere nye ansikter med spesifikke uttrykk.

Spør den til å generere et sett av uttrykk på et ansikt som er tilordnet til en annen møte, og har du begynnelsen på en overbevisende, automatisk generert, helt falsk video. Og så, selvfølgelig, internett skapt mye porno.

I desember 2017, bare én person som gjorde dette, ved hånden, legge inn sine resultater til Reddit. Ved starten av januar en app hadde blitt opprettet, og tilbyr en lett-å-bruke stykke programvare for å automatisere prosessen. Av februar, mer enn 90,000 personer var medlemmer av et samfunn dedikert til å skape og dele eksplisitt klipp.

Men “lett å bruke” kan bety mange forskjellige ting i tech, samfunn, fra “dette verktøyet vil ikke slette harddisken hvis du gjør en skrivefeil” å “rope” spill Kesha’ på vår illevarslende svart sylinder og det vil gjøre som du sier”. I januar, FakeApp var nærmere til den første av dem enn de andre; den muntre navn foreslått iPhone nivåer av lette, men det var en fryktelig stykke programvare.

Å låne en arbeidsstasjon datamaskinen fra Dell, var det første skritt for å få det til å kjøre.Som mange av AI-tech, FakeApp er utformet for å gjenbruke spill-Pc-er med tykke grafikk prosessorer, som the Guardian sårt mangler. Med den maskinvare sortert, kampen med programvaren kunne begynne.

Trump på Johnson v Thatcher Mai

En mislykket Faceswap av Boris Johnson og Donald Trump.

Som en kan forvente fra en anonym utvikler en app bygget for å aktivere ville være pornographers å bryte kroppslige autonomi på en industriell skala, er det ikke spesielt lett å bruke.

Umerkede valg er overalt, bare veiledningen er en 20-minutters YouTube-video, og det vil tøffer for fem minutter før bare sviktende med ingen forklaring hvis du har gjort noe galt. Og det er hvis du er heldig. Hvis du ikke er det, du vil ikke finne ut om en annen åtte til 24 timer opplæring, etter som systemet produserer noe som ser ut som dette:

Min Donald Trump på Boris Johnson test hadde mislyktes i en rekke måter. For en, det gikk tom for diskplass halvveis gjennom. Mens produksjonen av FakeApp er forbausende effektiv, som med mange nevrale nettverk, prosessen med trening nettverket bruker en stor mengde minne.

Men det slår også ut Johnson og Trump ikke er så kompatibel som avis cartoonists kanskje har du tror. Trump er lys oransje hud tone betyr det var alltid kommer til å bli merkelig å gips ansiktet hans på Johnson pastalignende-hvit kropp. Hva er mer, Trump er manglende evne til å stå stille eller snakke til kamera betyr at systemet er i stand til å oppdage sitt ansikt for omtrent halvparten av rammer, fordi det er skjult ved hans hånd eller vendt bort fra kamera.

Til slutt, jeg hadde mer suksess. Et klipp av Margaret Thatcher, som var tatt fra en 15-minutters tv-intervju fra 1980-tallet, fungerte bedre når den blir limt inn på et kort klipp av Theresa Kan skutt i februar. Resultatet ser, bafflingly, mye som Victoria Tre:

En bedre faceswap av Theresa May og Margaret Thatcher.

Mens bedre, dette swap fortsatt har problemer. I Thatcher er intervjuet, hun snakker til en intervjueren sitter ved skjermen, i stedet for direkte til kameraet. Det betyr at det nevrale nettverket aldri virkelig lærer hva hun ser ut som ansiktet på, noe som resulterer i noen svært merkelige bilder i det siste video.

For Edward Lucas dem rariteter er moot. Han fortalte MPs: “Det er alt litt klumpete. Det fungerer bedre i svart og hvitt enn i farger. Men på en måte, litt kornete clunky sort / hvit video er mer overbevisende, fordi det ser ut som noe folk kan ha skutt på telefonen sin.”

Moralsk grå og vanskelig å forene

Begrensningene i dagens teknologi ikke kommer til å vare lenge. Nevrale nettverk forskere bygge systemer som kan trenes på mindre og mindre informasjon, og systemer som kan bytte mer enn bare ansikter, men også hodet, hele kropper og selv stemmer. Blant fagfolk, for eksempel bytteavtaler har nesten blitt en fest triks, gjort for å vise hvor rask deres system fungerer, eller hvor mye mer troverdig det er enn konkurrentene.

Jack Clark

(@jackclarkSF)Her er grunnlegger av SenseTime, Xiao’ou Tang, viser en Trump<>Obama generativ AI faceswap ved lansering for en MIT-AI initiativ som SenseTime er å bidra til fondet. 2018 er å levere i form av AI-geopolitikk weirdness! https://t.co/emK9laObfu pic.twitter.com/iTHy5lVmwJ

1. mars 2018

I den andre enden av spekteret, FakeApp og dens ilk er bedre og enklere å bruke av dagen. I våre måneds testing av FakeApp det har utviklet seg fra en jury-rigget bunt av command-line verktøy for å en ganske heftig one-button-programmet. Fellesskapet har overlevd å bli kastet ut av nesten alle sosiale nettverk kommer, vanligvis for etablering av “ufrivillig pornografi”, og omgruppert på et forum som drives av app ‘ (anonym) – utviklere.

De ser seg selv som bud om den falske nyheter fremtiden, gjør verden en tjeneste ved å spre bevissthet om hvor lett det er å lage overbevisende forfalskninger. “Det vi gjør her er ikke sunt eller hederlig, det er nedsettende, vulgært, og blindsiding til kvinner som deepfakes fungerer på,” en bruker skrev, i et allment delt innlegget nå slettet sammen med subreddit det var delte på.

“Som sagt, det arbeidet som vi lager her i dette samfunnet er ikke med ondsinnede hensikter. Tvert imot. Vi maler med revolusjonerende, eksperimentell teknologi, en som kunne ganske muligens med på å forme fremtiden for medier og kreativ design.

“Uansett hva som skjer, denne teknologien skulle bli en realitet. Ingenting kunne stoppe det. Og ironisk nok, de tryggeste hender for det å være i kan bare være publikum med makt til å desensitise det, snarere enn en eksklusiv få, med makt til å utnytte den.”

Av dette leser, deepfakes mannskap er informasjon accelerationists, hastening bortfallet av vår felles virkelighet, for å sikre at den smertefulle forbigående periode, når ingen kan være sikker på hva som er virkelig og hva som ikke er det, er over så raskt som mulig. Hvis alle og deres hund vet om deepfakes, så kanskje skepsis vil regjere og Lucas er frykt ikke vil bli realisert.

Som moralsk grå vis er vanskelig å forene med måten samfunnet samtaler blant seg selv når den tror at ingen lytter. Deres fokus har en tendens til å være direkte på pornografi – med kjendis-ansikt-bytteavtaler er bare toppen av isfjellet. Mange forespørsler om hjelp er laget for å produsere ansikt-bytteavtaler med ex-kjærester, klassekamerater og lærere, som utgjør en del av grunnen til at samfunnet holder på å komme ut av Reddit.

Nye etiske spørsmål har oppdratt sine hoder, for: en moderator gikk i hardt når det ble klart at samlinger av bilder av Elle Fanning, som er 19, og Emma Watson, som er 27, trolig inneholdt bilder av dem tatt når de var yngre enn 18 år. Det er ikke klart hva den juridiske og moralske konsekvenser av bruk av et datasett som inneholder bilder av en kvinne som en voksen og et barn til å undervise et AI hva hun ser ut for å lime inn ansiktet hennes over et pornografisk video av en annen kvinne, men ingen ønsket å ta sine sjanser.

Og FakeApp er ikke bare forbruker skyve konvolutten. Adobe har programvare som kan endre et opptak av en ekte person så enkelt som å redigere et transkript av sine bemerkninger. Baidu, kjent i Vesten som Kinas Google, kan du gå en ytterligere, kloning en stemme mens man å endre sin aksent og kjønn.

Det er dystre. Men det kommer ikke til å gå bort. Teknologien er offentlig tilgjengelig, grundig dokumentert, og gjenstand for forskning rundt om i verden. Dette er vår verden nå. Som Lucas advart MPs: “Vær så snill å ikke bruke for mye tid på å se i speilet om hva Russland gjorde mot oss, se gjennom vinduet på hva som kommer ned veien. Det er mye farligere.”