Lederne af mere end et hundrede førende virksomheder inden for kunstig intelligens er meget bekymrede over udviklingen af “killer robotter”. I et åbent brev til FN ‘ s disse virksomhedsledere, herunder Elon musk af Tesla og grundlæggerne af Google DeepMind, har advaret om, at brug af teknologi Autonome våben kunne blive taget af terrorister og despoter, eller i varierende grad vil blive hacket.

Men den virkelige fare er langt mere alvorligt – og det er ikke kun den menneskelige adfærd, men også i motoren. Studiet af komplekse systemer viser, at de kan opføre sig langt mere uforudsigelig, end det kan udledes af summen af de enkelte tiltag. På den ene side betyder det, at det menneskelige samfund kan opføre sig på en helt anden måde, end man kunne forvente, at studere adfærd af enkeltpersoner. På den anden side, dette gælder også for den teknologi. Selv økosystem simpel kunstig intelligens programmer – som vi kalder dum, god robotter, der kan overraske os. Selv de enkelte bots kan opfører sig forfærdeligt.

De enkelte elementer, der omfatter komplekse systemer såsom økonomiske markeder eller det globale vejr, tendens til ikke at interagere på en enkel lineær måde. Dette gør disse systemer er meget svært at modellere og forstå. For eksempel, selv efter mange års forskning i klima er det umuligt at forudsige langsigtede adfærd vejr. Disse systemer er så følsomme, at de mindste ændringer i, hvordan eksplosive de reagerer. Det er meget vanskeligt at kende den præcise tilstand af sådan et system på et bestemt tidspunkt. Alt dette gør disse systemer internt uforudsigelige.

Alle disse principper gælder for store grupper af mennesker, der handler på deres egen måde, være det menneskelige samfund eller en gruppe af robotter med kunstig intelligens. For nylig har forskere studeret en af de typer af komplekse system, hvor god robotter, der anvendes til automatisk at redigere artikler på Wikipedia. Disse forskellige robotter, der er designet, skrevet og brugt af tillid til Wikipedia-skribenter, og deres underliggende software er open source, og er tilgængelig for alle. Individuelt, har de et fælles mål om at forbedre encyklopædi. Men deres kollektive adfærd viste sig at være overraskende ineffektive.

Baseret på arbejde af disse bots med Wikipedia er vel-etablerede regler og konventioner, men da web-site har ingen Central kontrol system, er der ingen effektiv koordinering mellem de mennesker, der kører forskellige robotter. Resultaterne viste et par af bots, der i flere år havde aflyst redigeringer af hinanden, og ingen lagde mærke til. Og, selvfølgelig, fordi disse bots ikke kan lære, at de ikke bemærker.

Disse robotter er designet til at fremskynde redigering proces. Men små forskelle i design mellem robotter eller mennesker, der bruger dem, kan føre til et massivt spild af ressourcer i den igangværende “krig for at redigere”, som ville blive løst meget hurtigere ved hjælp af redaktionen.

Forskerne fandt også, at de robotter, der opfører sig forskelligt i forskellige sprogversioner af Wikipedia. Regler, ville det virke, er næsten den samme, de mål, der er identiske med den teknologi, der er ens. Men i den tyske Wikipedia-bots samarbejde blev langt mere effektive og produktive end, for eksempel, på portugisisk. Dette kan kun forklares ved forskelle mellem redaktører-folk, der er ansvarlige for disse bots i forskellige miljøer.

Eksponentiel forvirring

Wikipedia bots ikke har en bred autonomi og systemet fungerer i overensstemmelse med de formål, de enkelte bots. Men Wikimedia Foundation planer om at bruge AI, der vil give mere autonomi, at disse bots. Og det vil sandsynligvis føre til endnu mere uforudsigelig adfærd.

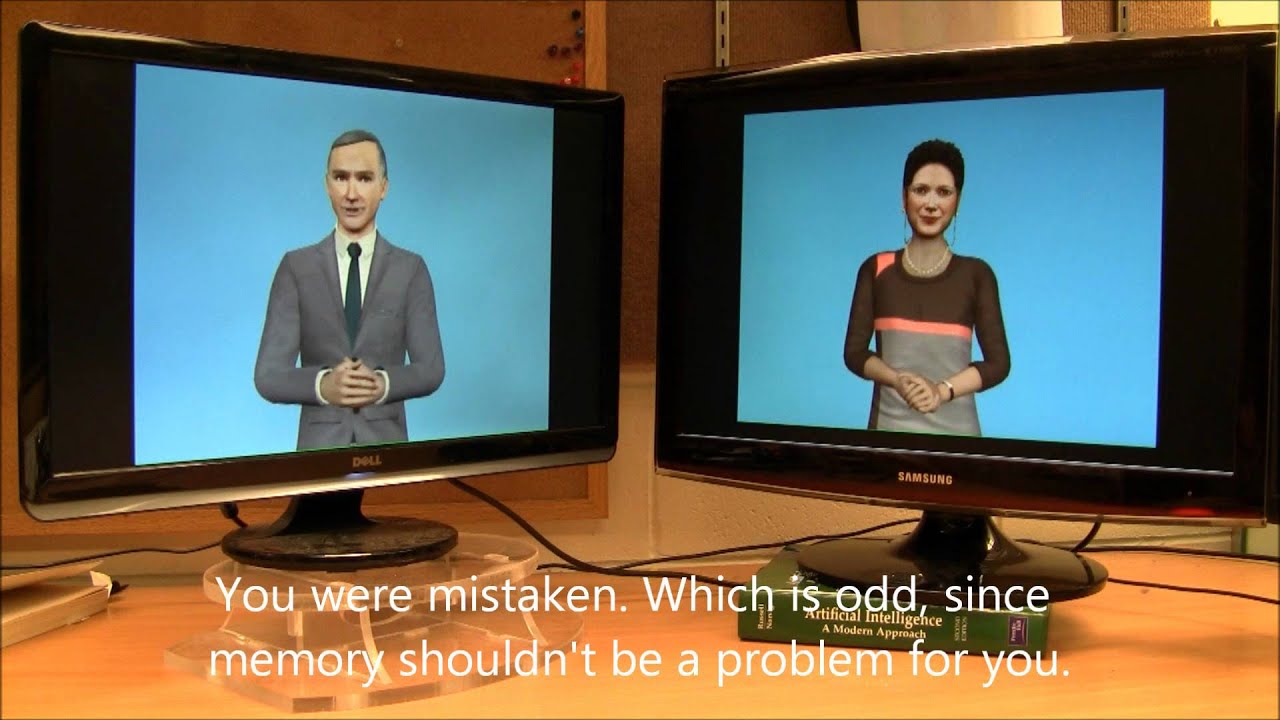

Et godt eksempel på, hvad der kan ske, viste, bots, oprettet for at snakke med folk, når de blev tvunget til at kommunikere med hinanden. Vi er ikke længere overrasket over de svar, med personlige assistenter, der ligesom Siri. Men gøre for dem at kommunikere med hinanden, og de hurtigt begynde at opføre sig på uventede måder, til at argumentere og selv fornærme hinanden.

Jo mere systemet bliver, og jo mere Autonome hver bot bliver, jo mere kompleks og uforudsigelig vil være den fremtidige opførsel af systemet. Wikipedia er et eksempel på arbejdet i en lang række relativt simple robotter. Eksempel på chat-robotter er et eksempel på et lille antal relativt avancerede og geniale bots – i begge tilfælde er der uforudsete konflikter. Kompleksiteten og dermed uforudsigelighed vokse eksponentielt, som du kan tilføje til systemet af individualitet. Så når du i fremtiden vil der være systemer med en lang række meget komplekse robotter, uforudsigeligheden af dem vil gå ud over vores fantasi.

Rasende vanvid

Selvkørende biler, for eksempel, løfte om at gøre et gennembrud i energieffektivitet og trafiksikkerhed. Men vi ved stadig ikke, hvad der sker, når vi har mere vilde systemet er fuldt Autonome biler. De kan opføre sig forskelligt selv inden for en lille flåde af individuelle køretøjer i et kontrolleret miljø. Og endnu mere uforudsigelig adfærd kan opstå, når selvkørende biler, “uddannet” af forskellige mennesker i forskellige steder vil begynde at interagere med hinanden.

Folk kan tilpasse sig til nye regler og aftaler, der relativt hurtigt, men den er svær at skifte mellem de forskellige systemer. Kunstige stoffer kan være endnu sværere. For eksempel, hvis “uddannet i Tyskland” bil, for eksempel, skal du gå til Italien, vi ikke ved, hvordan han vil lære uskrevne kulturelle aftale, som er fulgt af mange andre “, der er uddannet i Italien” biler. Noget banalt som at krydse krydset kan være dødeligt risikabelt, fordi vi bare ikke vide, om de maskiner til at interagere ordentligt, eller begynder at opføre sig uforudsigeligt.

Nu tænker de killer robotter, der generer Masken og hans kolleger. En killing machine kan være meget farlige i de forkerte hænder. Og systemet uforudsigelige killer robotter? Tænk for dig selv.

Killer robotter? Stop, selv de gode robotter er uforudsigelige, til skræk og rædsel

Ilya Hel