Millioner av unge spillere som er vant til å konfrontere “bad guys.” Men ofte er deres verste fiender er kolleger i spillet. Mange online spill-nettsteder er rasende undertrykkelse, frykt. Noen har til og med truet med døden. Dette er et vanlig problem for mange nettsamfunn, inkludert Twitter, YouTube og Facebook.

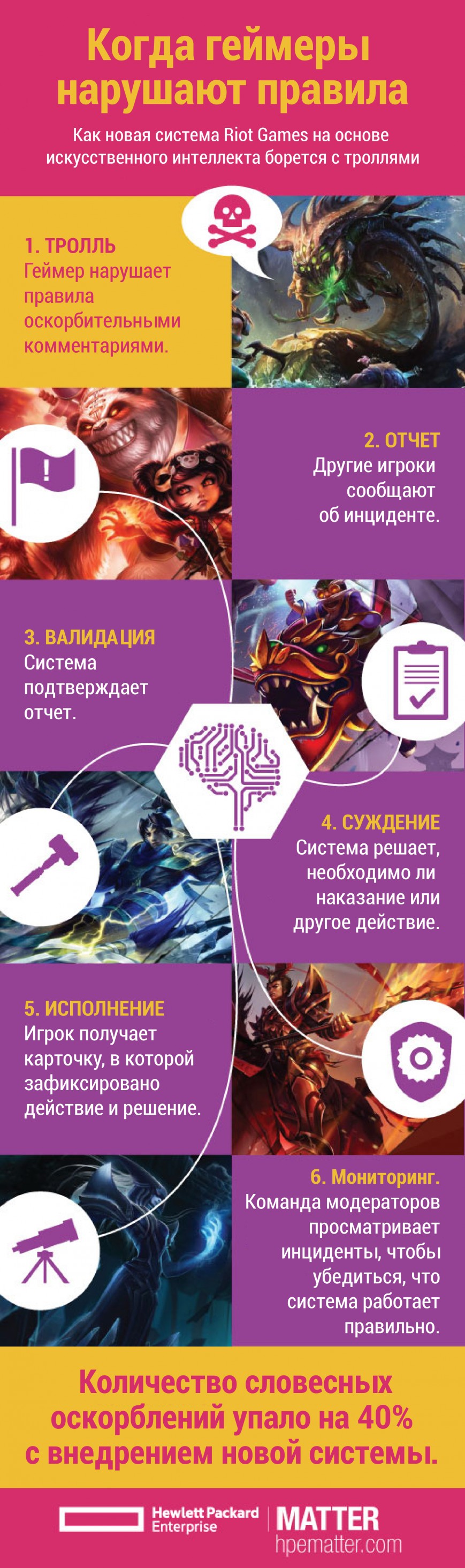

Hvordan til å skille bråkmakere? For flere år, Riot Games, som produserer den enormt populære spillet League of Legends, eksperimentere med kunstig intelligens verktøy og prediktiv Analytics for å identifisere online troll, og for å gjenopprette ånden av spillet. Spillerne i Ligaen vil hjelpe deg til å oppdage “black sheep”, og gjør vedtak om nødvendige tiltak. Deres vurderinger er analysert av kunstig intelligens program som kan nesten uavhengig av hverandre for å identifisere, utdanne, re-utdanne og disiplin spillerne.

Riot Games, er å se på hvordan du kan selv regulere en stor og mangfoldig online samfunnet. Denne kunnskapen kan brukes på ulike måter: for eksempel, for å gjøre teamarbeid mer effektive, avhengig av personlighet typer eller til bedre å forstå hvordan våre online-identitet gjenspeiler den virkelige.

“Vi pleide å tenke at online spill og destruktiv atferd er uløselig knyttet sammen, sier Jeffrey Lin (Jeffrey Lin), chief spillet designer av sosiale systemer på Riot Games. “Men nå vet vi at de fleste spillere vil finne dette problemet ekkelt. Vi ønsker å skape et kulturelt miljø som viser hva et godt spill.”

For å oppnå dette målet er ikke lett. Riot Games alltid regulere atferden til spillerne er forbudt trakassering og rasisme, sexisme, kulturell diskriminering, homofobi. Imidlertid, i tilfelle av League of Legends mengden av daglige aktiviteten er ikke tillatt å håndheve reglene på tradisjonelle måter og innsatsen til moderatorene. Mer enn 27 millioner mennesker spiller minst ett spill som League of Legends en dag, og i rushtid kan samtidig spille på mer enn 7,5 millioner spillere.

Dette er en av grunnene Riot Games tildeler betydelige ressurser for dette initiativet. Jeffrey Lin, som har doktorgrad i kognitiv psykologi, som arbeider på den sammen med andre forskere, som spetsializiruyutsya på hjernen. For å opprette en teknisk plattform var ikke en lett oppgave. For å slå petabyte av anonyme data til nyttig innsikt i brukeratferd, det var nødvendig å rørledning data. Team Lin har også samarbeidet med designere for å sikre at deres arbeid ikke berører grensesnittet av spillet.

Fase 1: Tribunalet

I den første fasen av programmet, som startet i 2011, spillere rapporterte overtredelser av regler av andre spillere. Disse rapportene ble mottatt i den offentlige registrering system, den såkalte Domstol der hendelsene ble vurdert av den enkelte spiller. Hvert enkelt tilfelle vanligvis er inkludert korrespondanse i chatten, statistikk og spill og annen informasjon basert på som en kommentator må bestemme seg for om å straffe eller benådning de tiltalte. De fleste av tilfellene, i henhold til Lina, som skjedde da spillere med normal atferd, det var noen problemer, og de bare sprutet dem i spillet.

Spillerne ble evaluert i sammenheng med en negativ kommentar til å stemme, hvor alvorlig bør være straff. Nivåene var forskjellige fra e-post, beskjedent og minner overtredelse av reglene, til langsiktig sperring av konto. Etter at systemet har samlet inn millioner av stemmer, Riot Games stengt av Domstolen i 2014, og begynte å jobbe på et system med kunstig intelligens.

“Det er to måter å takle problemer i denne størrelsesorden, og vi bruker begge,” sier Eric Roberts, Direktør for kommunikasjon for Riot Games. “Først, la verktøy i hendene på samfunnet, og deretter bygge en trenbar system som bruker en skala av innkommende data for å få bukt med problemet.”

Fase 2: kunstig intelligens

Siste år, Riot Games i gang for å teste dens system av “re-utdanning av spillere, som gir raskere tilbakemeldinger og delvis automatiseret prosessen. Et system som er konfigurert til å identifisere verbale overgrep som kan sende spillere på et spesielt kort som inneholder bevis på deres upassende oppførsel. Team Lina alene kjørte flere tusen første ganger for å sørge for at alt fungerer, og resultatene var forbløffende: mengden av verbale overgrep har falt med 40 prosent siden han lanserte den Domstol og et nytt program med kunstig intelligens.

Lin er overbevist om at mange utviklere vil arve denne modellen er å koble kognitiv forskning for å forbedre spillet, og å ansette en tverrfaglig team. “Vi perevospitat spillere som gir dem tilbakemelding, og stimulere til diskusjon i samfunnet, sier Lin. “Vi viste at vi kan endre kultur, ved å bruke de riktige verktøyene.”

For å lære hvordan big data, automasjon og kunstig intelligens endre fremtiden, last ned rapporten HPE “Big Data i 2016”