Una nuova ricerca mostra che il cervello e la capacità di memoria è di dieci volte superiore rispetto alla precedente stima. Il che significa che in petabyte di gamma—che la mette vicino al World Wide Web territorio.

Il cervello umano è spesso paragonato a un computer. Un aspetto in particolare che si presta bene a questo tipo di confronto è la memoria. Quando il computer gli scienziati parlano di memoria, consultare la RAM (random access memory) e di memorizzazione delle unità disco. Quando si fa riferimento al cervello umano, i neuroscienziati parlare di memoria a breve termine, che è come la RAM e la memoria a lungo termine, che è simile a un disco rigido. Di conseguenza, gli scienziati trovano utile analogize il nostro cervello capacità di archiviazione a un computer, il che spiega perché si misura in bit e byte.

Purtroppo, c’è una mancanza di consenso sulla quantità di informazioni che il nostro cervello è in grado di memorizzare. Le stime variano da un terabyte di 100 terabyte di 2500 terabyte (un terabyte di essere di 1.000 gigabyte). Ma un nuovo studio del Salk Institute mostra, queste stime sembrano essere di un ordine di grandezza troppo bassa. Con la creazione di un computazionale ricostruzione di un segmento di un ratto, il suo cervello, un team guidato dal Salk Institute Terry Sejnowski ha dimostrato che il cervello umano è la capacità di memoria è in realtà in petabyte di gamma. I dettagli del loro lavoro, possono ora essere trovato scienza rivista eLife.

“Questa è una vera e propria bomba nel campo delle neuroscienze”, ha detto Sejnowski, in un comunicato stampa. “Abbiamo scoperto la chiave per sbloccare il principio di progettazione per come neuroni ippocampali funzione con energia bassa, ma alta potenza di calcolo. Le nostre nuove misure per il cervello memoria di aumentare la capacità delle stime conservative di un fattore 10 per almeno un petabyte, nella stessa ballpark, come il World Wide Web.”

Per essere onesti, nella stessa zona generale come il Web, ma non è proprio la stessa ballpark, come il Web. Il Salk ricercatori sembrano essere esagerando un po’. Se consideriamo la Grande Quattro Google, Amazon, Microsoft e Facebook—i loro server da solo memorizzare almeno 1.200 petabyte tra di loro. Che esclude il resto del Web, tra cui fornitori di storage, come Dropbox, Barracuda, e SugarSync.

Sponsorizzato

Ma un petabyte è ancora un’enorme quantità di dati. Espressa numericamente, 250 byte. Una buona analogia è la quantità totale di dati raccolto presso la Libreria del Congresso, che è di circa 235 terabyte. Un petabyte è di circa quattro volte. Mettere un altro modo, un petabyte è sufficiente per memorizzare il DNA di tutta la popolazione degli Stati Uniti per ben due volte. Così il nostro cervello non può avere l’equivalente capacità di archiviazione di tutto il Web, ma è ancora un enorme di dati serbatoio.

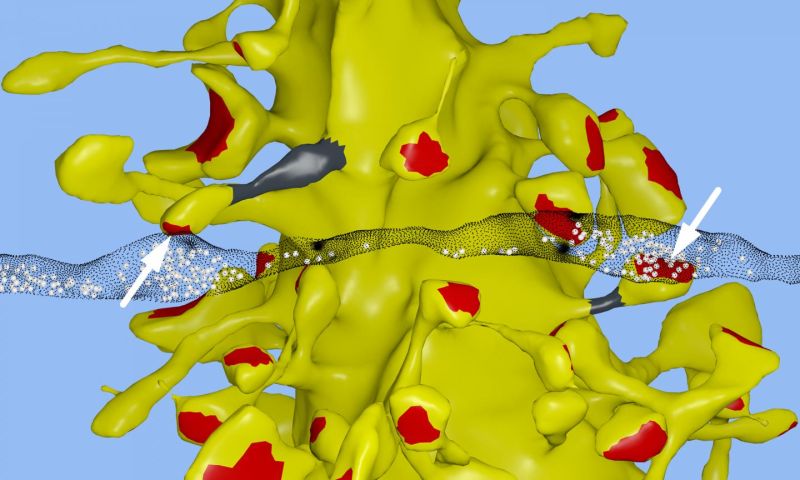

Il team ha creato un computazionale la ricostruzione 3D dell’ippocampo di ratto tessuto (la memoria centro del cervello), che ha rivelato qualcosa di molto inaspettato. Alcuni neuroni sembrava essere l’invio di messaggi duplicati per ricevere i neuroni. Incuriositi, i ricercatori hanno deciso di misurare e confrontare le dimensioni di due simili sinapsi, che si vorrebbe perfezionare la loro comprensione di synaptic dimensioni. Ciò è in contrasto con quanto neuroscienziati genere si riferiscono alle dimensioni dei neuroni in termini di piccole, medie e grandi dimensioni. Questo è problematico, dato che la capacità di memoria di neuroni dipende dalla dimensione delle sinapsi.

I ricercatori hanno scoperto che le sinapsi di tutte le dimensioni variano in piccoli incrementi di otto per cento. Quindi ci potrebbe essere ben 26 categorie di misure di sinapsi. Questa “plasticità sinaptica” significa che ci sono 10 volte più discrete dimensioni delle sinapsi di quanto si pensasse. In termini computazionali, che equivale a circa il 4,7 bit di informazione. Prima di questo studio, i neuroscienziati hanno pensato che il cervello è in grado di solo uno o due bit per brevi e lunghi di archiviazione di memoria nell’ippocampo.

“Questo è circa un ordine di grandezza di precisione più di quanto chiunque abbia mai immaginato”, ha detto Sejnowski.

Questa scoperta aiuta anche a spiegare il cervello sorprendente efficienza energetica, che potrebbe portare alla ultraprecise, super-efficiente, computer, compresi quelli che utilizzano un profondo apprendimento artificiale e reti. Allo stesso modo che i computer ci stanno aiutando a capire il cervello umano, questi tipi di neurale intuizioni ci stanno aiutando a costruire più efficiente e potente computer.

[eLife]

Immagine in alto: Salk Institute

E-mail all’autore george@gizmodo.com e a seguirlo @dvorsky.