Artificiell intelligens har visat sig vara mycket kapabel verktyg om vi talar om att manipulera video med människor. Den så kallade “deepface” med byte individer blir de ljusa exempel, men nya tillämpningar dyker upp varje dag. Det senare skapar gipface för dans — artificiell intelligens läser dans och rörelse av en annan person och lägger den på mål kroppen.

Den vetenskapliga sidan av detta alternativ var engagerad i fyra studier från University of California i Berkeley. Som de beskriver i en artikel publicerad i arXiv, deras system består av flera diskreta steg. För det första, inspelad live med syfte och rutin visar sin rörelse till en streckgubbe. (För god kvalitet kommer att kräva ca 20 minuter av skytte på 120 fps). Sedan är källan till video och figur med pinnar tar bort rörelse. Sedan är det att dela och neurala nätverk syntetiserar en video med ett mål enskilda baseras på rörelse stick siffrorna.

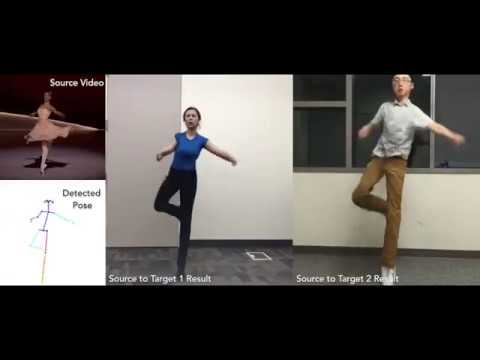

Det ser fantastiskt ut. Se själv:

Det neurala nätverket som skapar din dans

Låter självklart, men det är faktiskt mycket mer komplicerat. Till exempel, det är en rutin som jämnar ut flödet av siffrorna, så att dansarna inte starkt drag, och en helt separat nät som är avsedda för re-spårning av ansiktet som mål att se till realism.

Programmet har sina begränsningar. Nätverket kan inte exakt modell lös vävnad, så att det mål som personen behöver för att bära åtsittande kläder. Träffas och avvikelser. I alla fall, arbetet är imponerande.

Du längtar efter att dansa balett? Berätta för oss i vår chatt i Telegram.

Du kommer inte tro dina ögon: detta neurala nätverk kommer att dansa för dig

Ilya Hel