Ja, min AI-face-swap försök kan visa hur svårt det är att göra en deepfake – men det blir lättare för varje dag

@alexhern

Mon 12 Mar 2018 06.00 GMT

Senast ändrad Mån 12 Mar 2018 06.01 GMT

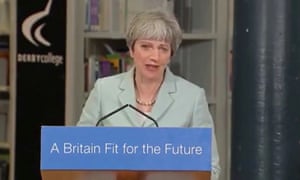

Maggie May … men min Theresa Thatcher falska ser bafflingly liknar Victoria Trä.

Foto: Alex Hern för Guardian

MPs från House of Commons utredning av falska nyheter blev varnade i förra veckan för en ny AI-teknik som är på väg att förändra världen, och inte till det bättre.

“Vi är snabbt på väg in i en era där Ryssarna eller någon annan motståndare, kan skapa våra offentliga siffror som säger eller gör saker som är kränkande eller starkt frätande för att allmänhetens förtroende,” Edward Lucas, senior vice president för Centre for European Policy Analysis berättade för Riksdagsledamöter. “Och vi är inte alls redo för detta.”

Lucas pratade om så kallade deepfakes, som han beskrev som “ljud och video som ser ut och låter som den riktiga personen, säga något som den personen har aldrig”.

Mindre än tre månader sedan, att producera sådana filmer var en mödosam process som kräver en video editor, stora mängder av referens bilder och år av erfarenhet. Men under de första månaderna av detta år, är den teknik som har exploderat i allmänna tillgänglighet.

Jag ville testa varningar för Lucas, och de före honom, att ta reda på hur nära vi är att denna sköna nya värld. Jag fann att även om det är sant är det nu lättare än någonsin att skapa en övertygande falska video med två ansikten byts, det är fortfarande inte precis lätt.

Ansikte bytte porr

Visa ett neuralt nätverk tillräckligt med exempel på ansikten från två kändisar och det kommer att utveckla sin egen mentala modell av hur de ser ut, som kan generera nya ansikten med olika uttryck.

Be den att skapa en uppsättning uttryck på ett ansikte som mappas till ett andra ansikte, och du har början på ett övertygande, genereras automatiskt, helt falsk video. Och så, naturligtvis, internet skapade en hel del porr.

I December 2017, bara en person som gjorde detta, för hand, att publicera sina resultat på Reddit. I början av januari en app hade skapats, som erbjuder en enkel att använda mjukvara för att automatisera processen. Senast i februari, mer än 90 000 människor var medlemmar i en gemenskap dedikerade till att skapa och dela den explicita klipp.

Men “lätt att använda” kan betyda en massa olika saker i tech samhällen, från “detta verktyg kommer inte att radera din hårddisk om du gör ett stavfel” för att “skrika” spela Kesha’ på vår olycksbådande svart cylinder och det kommer att göra som du säger”. I januari, FakeApp var närmare den första av dem än den andra; det glada namnet som föreslås iPhone nivåer av lätthet, men det var ett hemskt program.

För att låna en arbetsstation dator från Dell var det första steget för att få det att köra.Gillar en hel del av AI-tech, FakeApp är utformad för att styra gaming Datorer med biffiga grafikprocessorer, vilket Väktare i högsta grad saknar. Med hårdvara sorteras, kampen med programmet kunde börja.

Trumf på Johnson v Thatcher Maj

En misslyckad Faceswap av Boris Johnson och Donald Trump.

Som man kan förvänta sig från en anonym developer ‘ s app som byggts för att möjliggöra skulle vara pornographersna att bryta mot kroppslig autonomi i industriell skala, är det inte särskilt lätt att använda.

Omärkta alternativ finns överallt, bara att handledning är en 20-minuters YouTube-video och det kommer att drick för fem minuter innan enkelt inte med någon förklaring om du har gjort något fel. Och det är om du har tur. Om du inte, du kommer inte hitta en annan åtta till 24 timmar av träning, efter som systemet producerar något som ser ut så här:

Min Donald Trump på Boris Johnson test hade misslyckats i ett antal olika sätt. För en, det tog slut på diskutrymme halvvägs igenom. Medan produktionen av FakeApp är häpnadsväckande effektiv, som med många neurala nätverk, processen för utbildning nätverket använder en stor mängd minne.

Men det visar sig också Johnson och Trump är inte så kompatibla som tidningen tecknare kan få dig att tänka. Trump är ljust orange hudton innebär att det alltid kommer att vara udda till gips hans ansikte på Johnson ‘ s pirog-vit kropp. Vad är mer, Trump ‘ s oförmåga att stå still eller prata med kameran innebär att systemet inte se hans ansikte för ungefär hälften av de ramar, eftersom det är dolt av hans hand eller vänd bort från kameran.

Så småningom, jag hade mer framgång. Ett klipp av Margaret Thatcher, som tagits från en 15-minuters tv-intervju från 1980-talet, fungerade bättre när klistras på att ett kort klipp av Theresa Kan skjuten i februari. Resultatet ser ut, bafflingly, en hel del som Victoria Wood:

En bättre faceswap av Theresa Maj och Margaret Thatcher.

Samtidigt bättre, i denna swap fortfarande har frågor. I Thatchers intervju berättar hon att en intervjuare sitter off-skärmen i stället för direkt till kameran. Det innebär att det neurala nätverket aldrig riktigt lär sig vad hon ser ut som ansikte på, vilket resulterade i några mycket udda ramar i den färdiga videon.

För Edward Lucas dessa underligheter är omtvistad. Han berättade för MPs: “Det är lite otymplig. Det fungerar bättre i svartvitt än i färg. Men på ett sätt, något grynig otymplig svart och vitt video är mer övertygande, eftersom det ser ut som något människor kan ha skjutit på sin telefon.”

Moraliskt grå och svårt att förena

Begränsningar i den nuvarande tekniken inte kommer att hålla länge. Neurala nätverk för forskare är att bygga system som kan tränas på mindre och mindre information och system som kan byta mer än bara ansikten men även huvuden, kroppar och till och med röster. Bland yrkesverksamma, såsom swappar har nästan blivit ett party trick, gjort för att visa hur snabba deras system fungerar, eller hur mycket mer trovärdigt det är, än konkurrensen.

Jack Clark

(@jackclarkSF)Här är grundaren av SenseTime, Xiao’ou Tang, visar upp Trumf<>Obama generativ AI faceswap vid lanseringen för en MIT AI initiativ som SenseTime är att bidra till att finansiera. 2018 är att leverera i form av AI-geopolitik konstigheter! https://t.co/emK9laObfu pic.twitter.com/iTHy5lVmwJ

1 mars 2018

I andra änden av spektrumet, FakeApp och dess gelikar är att få bättre och enklare att använda av den dagen. Under vår månadslånga testning av FakeApp det har utvecklats från ett jury-riggade bunt kommandoradsverktyg för att en ganska smart en-knapp ansökan. Gemenskapen har överlevt kastas av nästan alla sociala nätverk kommer, oftast för skapandet av “de ofrivilliga “pornografi”, och grupperats på ett forum som drivs av app (anonym) utvecklare.

De ser sig själva som ett förebud om den falska nyheter, kommande, gör världen en tjänst genom att sprida medvetenhet om hur lätt det är att skapa övertygande förfalskningar. “Vad vi gör här är inte hälsosamt eller hedervärda, det är nedsättande, vulgärt, och blindsiding till kvinnor som deepfakes fungerar på,” en användare skrev, i en allmänt delad inlägg nu bort tillsammans med subreddit det var delade på.

“Som sagt, det arbete som vi skapar här i denna gemenskap är inte med ont uppsåt. Tvärtom. Vi är målning med revolutionerande, experimentell teknik, som helt skulle kunna forma framtiden för media och kreativa design.

“Oavsett vad som händer, denna teknik kommer att bli verklighet. Ingenting kunde stoppa det. Och ironiskt nog, de säkraste händer för att det ska vara kanske bara allmänheten med makt att desensitise det, snarare än en exklusiv några, med makt att utnyttja den.”

Genom denna läsning, deepfakes besättning är information accelerationists, skynda nedläggningen av vår gemensamma verklighet för att säkerställa att den smärtsamma övergående period, då ingen kan vara säker på vad som är verkligt och vad som inte är det, är över så snabbt som möjligt. Om alla och deras hund vet om deepfakes, då kanske skepsis kommer att regera och Lucas farhågor inte kommer att realiseras.

Att moraliskt grå bakgrund är svårt att förena med hur samhället talar bland själva när de tror att ingen lyssnar. Deras fokus tenderar att vara direkt på pornografi – med celebrity face-swappar är bara toppen av isberget. Ofta förfrågningar om hjälp är gjorda för att producera ansikte-swappar med ex-flickvänner, klasskamrater och lärare, utgör en del av anledningen till att gemenskapen blir kastad av Reddit.

Nya etiska problem som har fötts upp sina huvuden: en moderator klev in hårt när det blev klart att samlingar av foton av Elle Fanning, som är 19 år, och Emma Watson, som är 27, förmodligen innehöll bilder av dem tagit när de var yngre än 18. Det är inte alls klart vad den juridiska och moraliska konsekvenserna är av att använda ett dataset som innehåller bilder av en kvinna som en vuxen och ett barn att lära en AI hur hon ser ut för att klistra in sitt ansikte under en pornografisk video av en annan kvinna – men ingen ville ta sina chanser.

Och FakeApp är inte det enda konsumenten teknik att trycka på kuvertet. Adobe har ett program som kan ändra en inspelning av en verklig person så enkelt som att redigera en utskrift av deras kommentarer. Baidu, känd i Väst som Kinas Google, kan gå ett steg längre, kloning en röst och samtidigt förändrar sin dialekt och kön.

Det är bistra. Men det kommer inte att gå bort. Den teknik som är allmänt tillgänglig, väldokumenterade, och föremål för forskning runt om i världen. Detta är vår värld nu. Som Lucas varnade MPs: “du behöver inte spendera alltför mycket tid på att titta i backspegeln på vad som gjorde Ryssland till oss; se genom vindrutan på vad som kommer på vägen. Det är mycket farligare.”