Det ser ud til, at computere kan allerede nu læse vores sind. Google autocomplete foreslåede venner på Facebook og målrettede reklamer, som Dukker op i din browser, nogle gange gøre dig tænke: hvordan virker det? Vi er langsomt, men sikkert bevæger sig i retning af computere at læse vores sind, og en ny undersøgelse fra Kyoto, Japan, var klart et skridt i denne retning.

Et team af forskere fra Kyoto University har brugt en dyb neurale netværk til at læse og fortolke folks tanker. Lyder det utroligt? I virkeligheden, ikke til den første tid. Forskellen er, at tidligere metoder og resultater — det var lettere, de havde dekonstrueret billedet-baseret og pixel, og grundlæggende kredsløb. Ny teknologi, kaldet “dybt billede genopbygning”, der er uden for den binære pixels og giver forskere med evnen til at afkode billede med flere lag af farve og tekstur.

“Vores hjerne behandler visuel information ved udvinding af hierarkiske træk af forskellige niveauer eller komponenter af forskellig kompleksitet,” siger Yukiyasu Kamitani, en af de videnskabsmænd, der var involveret i undersøgelsen. “Disse neurale netværk eller model AI kan bruges som en proxy for den hierarkiske struktur i den menneskelige hjerne”.

Undersøgelsen fandt sted for 10 måneder. I undersøgelsen er tre personer, der har studeret billeder af tre forskellige kategorier: naturlige fænomener (dyr eller mennesker), kunstig geometriske figurer og bogstaver i alfabetet.

Hjernens aktivitet blev målt ved observatører enten mens du ser billederne, eller efter. Til at måle hjernens aktivitet efter visning af billeder, folk er simpelthen bedt om at tænke på de billeder, som de blev vist.

Registreret virksomhed, der er så fed, at det neurale netværk, som er “afkodet” data og brugt dem til at skabe deres egne fortolkninger af de tanker om mennesker.

Hos mennesker (og, ja, alle pattedyr) visuel cortex placeret på bagsiden af hjernen, occipital lap, som er over cerebellum. Aktivitet i visuel cortex, der måles ved hjælp af funktionel magnetisk resonans billeddannelse (fMRI), der blev omdannet til den hierarkiske træk med dybt neurale netværk.

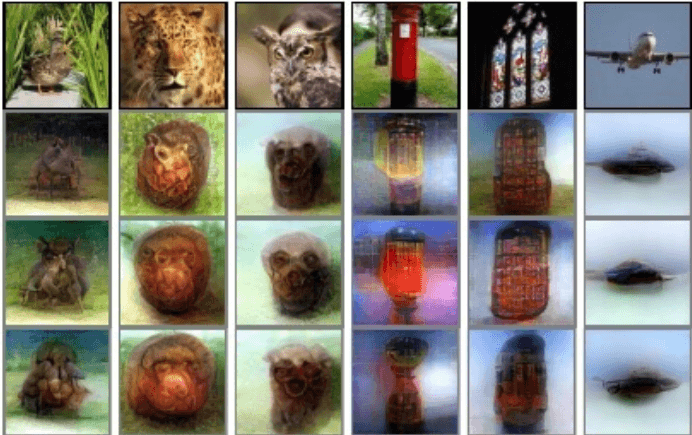

Du starter med et tilfældigt billede, netværket er iterativt optimerer pixel værdier af dette billede. Funktioner i introduktion til neurale netværk image bliver der ligner at de har afkodet fra hjernens aktivitet.

Vigtigere er, at den model, forskere blev trænet ved hjælp af kun naturlige billeder (mennesker eller natur), men jeg lærte at omforme en menneskeskabt form. Dette betyder, at den model, der virkelig er “genereret” billede, startende fra hjernens aktivitet, og ikke sammenligne denne aktivitet med de eksisterende eksempler.

Ikke overraskende, den model, der havde vanskeligheder med afkodning af hjernens aktivitet, når folk blev bedt om at huske billedet, og det er lettere, når de er direkte ses af disse billeder. Vores hjerner kan ikke huske alle de detaljer, der ses billeder, så minderne vil altid være vag.

De rekonstruerede billeder fra undersøgelsen bevare en vis lighed med de oprindelige billeder ses af deltagerne, men for det meste synes at være så minimalt detaljeret klatten. Men den nøjagtighed af den teknologi kun vil forbedre, og det vil udvide og mulige anvendelser.

Forestil dig, “instant art”, når du kan skabe et kunstværk, blot ved at præsentere den i mit hoved. Eller hvis AI vil registrere din hjerne aktivitet, mens du sover, og derefter genskabe dine drømme til analyse? Sidste år helt lammede patienter til at kommunikere med deres familier gennem brain-computer interface.

Der er masser af mulige anvendelser af den model, der anvendes i Kyoto-undersøgelse. Men brain-computer interfaces kan også genskabe de forfærdelige billeder, hvis vi lærer at kunne fortolke hjernens aktivitet. Omkostningerne for fejl i tilfælde af forkert at læse tanker kan være for høj.

Med alt dette, er det Japanske selskab, er ikke alene i sin indsats for at skabe et sind-læsning AI. Elon Musk grundlagt Neuralink at skabe brain-computer interface mellem mennesker og computere. Kernen er, som arbejder på at udvikle chips, der kan læse og skrive det neurale kode. Tankelæsning er langsomt ved at udvikle.

Japansk neurale netværk, der er undervist i at “læse tanker”

Ilya Hel