Millioner af unge spillere, der er vant til at konfrontere de “onde.” Men ofte er deres værste fjender er kolleger i spillet. Mange online gaming websteder, raser undertrykkelsen, intimidering. Nogle har endda truet med døden. Dette er et fælles problem for mange online-fællesskaber, herunder Twitter, YouTube og Facebook.

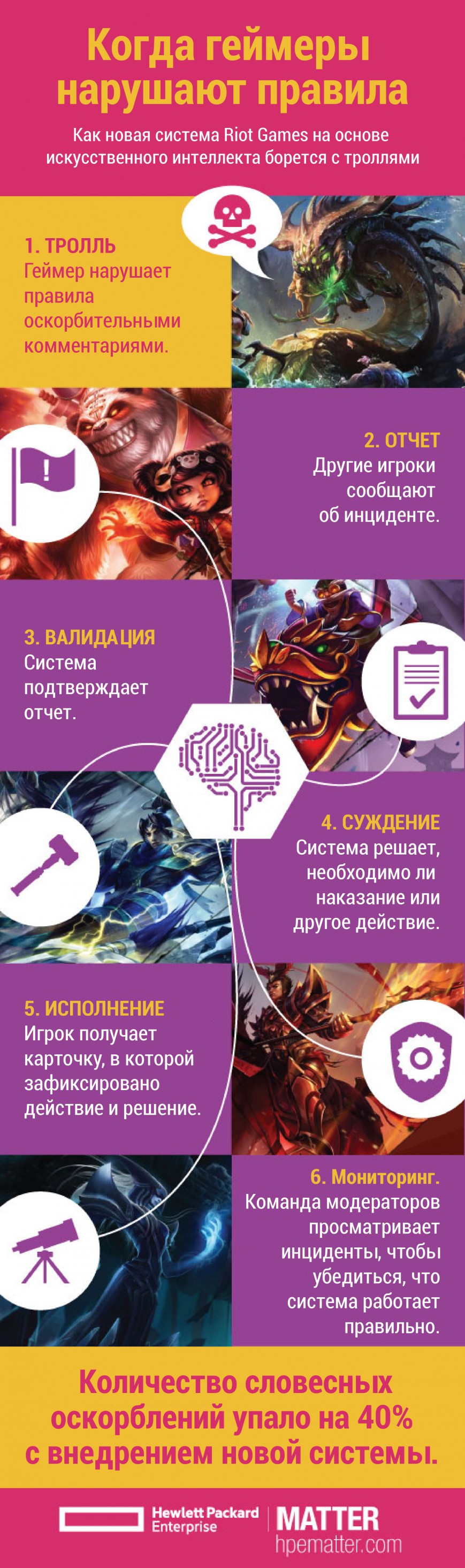

Hvordan til at adskille ballademagere? For flere år, Riot Games, der producerer den enormt populære spil League of Legends, at eksperimentere med kunstig intelligens værktøjer og predictive Analytics til at identificere online trolde og at genskabe ånden i spillet. Spillerne i Ligaen vil hjælpe dig til at opdage “sorte får”, og træffe beslutning om de nødvendige foranstaltninger. Deres domme er analyseret af kunstig intelligens program, der kan næsten selvstændigt at identificere, uddanne, gen-opdrage og disciplinere spillere.

Riot Games er at se på, hvordan selv kan regulere en stor og forskelligartet online-community. Denne viden kan bruges på forskellige måder: for eksempel, for at gøre teamwork mere effektiv, afhængigt af personlighed typer, eller til bedre at forstå, hvordan vores online identitet, der afspejler de virkelige.

“Vi plejede at tænke, at online-spil og destruktiv adfærd er uløseligt forbundet,” forklarer Jeffrey Lin (Jeffrey Lin), chief game designer af sociale systemer på Riot Games. “Men nu ved vi, at de fleste spillere vil finde denne adfærd ulækkert. Vi ønsker at skabe et kulturelt miljø, der viser, hvad et godt spil.”

For at opnå dette mål er ikke let. Riot Games altid regulere adfærd af spillere er forbudt chikane og racisme, sexisme, kulturel diskrimination, homofobi. Men i tilfælde af League of Legends mængden af daglige aktiviteter er ikke tilladt at håndhæve reglerne for de traditionelle måder, og den indsats, som moderatorer. Mere end 27 millioner mennesker spiller mindst et spil League of Legends en dag, og i myldretiden kan samtidig spille mere end 7,5 millioner spillere.

Dette er en af grundene til, Riot Games afsætter betydelige ressourcer til dette initiativ. Jeffrey Lin, hvis ph.d. – grad i kognitiv neurovidenskab, der arbejder på det sammen med andre forskere, som spetsializiruyutsya på hjernen. For at skabe en teknisk platform, var heller ikke en let opgave. Til gengæld petabytes af anonyme data til brugbar viden om brugernes adfærd, var det nødvendigt at rørledningen data. Team Lin har også samarbejdet med designere at sikre, at deres arbejde påvirker ikke grænsefladen af spillet.

Fase 1: Retten

I den første fase af programmet, som startede i 2011, spillere overtrædelser af reglerne af andre spillere. Disse rapporter blev modtaget i den offentlige registrering system, den såkaldte Retten, hvor de hændelser, der blev anset som af de enkelte spillere. Hver sag, der typisk indgår i den korrespondance, chat -, statistik og spil og andre oplysninger, der er baseret på, som en kommentator skal beslutte, om at straffe eller tilgive den anklagede. De fleste af de sager, der i henhold til Lina, der skete, da spillere med normal adfærd, der var nogle problemer, og de bare sprøjtede dem i spillet.

Spillerne blev vurderet i forbindelse med en negativ kommentar til afstemning, hvor alvorlige skal være straf. De niveauer, der var forskellig fra den e-mail, beskedent minde overtrædelse af reglerne er, at langvarig blokering af kontoen. Efter at systemet har indsamlet millioner af stemmer, Riot Games lukke ned ved Retten i 2014 og begyndte at arbejde på et system med kunstig intelligens.

“Der er to måder til at klare problemer af denne størrelsesorden, og vi bruger begge dele,” siger Eric Roberts, Direktør for kommunikation for Riot Games. “For det første, lad værktøjer i hænderne på fællesskabet, og derefter bygge en trainable system, der bruger en skala fra indgående data for at håndtere problemet.”

Fase 2: kunstig intelligens

Sidste år, Riot Games er begyndt at teste sit system af “re-uddannelse af spillere, hvilket giver hurtigere feedback og delvist automatiseret proces. Et system, der er konfigureret til at identificere, verbal misbrug, der kan sende spillere en speciel-kort, der indeholder dokumentation for deres upassende opførsel. Team Lina alene løb flere tusinde første gange for at sikre, at alt fungerer, og resultaterne var forbløffende: det beløb, verbal misbrug er faldet med 40 procent, siden han lancerede Retten og et nyt program med kunstig intelligens.

Lin er overbevist om, at mange udviklere vil arve denne model er at forbinde kognitiv forskning for at forbedre spillet, og leje et tværfagligt team. “Vi perevospitat spillere, der giver dem feedback og sætte gang i diskussionen i det samfund,” siger Lin. “Vi viste, at vi kan ændre den kultur, ved hjælp af de rigtige værktøjer.”

At lære, hvordan big data, automation og kunstig intelligens til at ændre fremtiden, download rapporten HPE “Big Data i 2016”