Selvkjørende biler er allerede cruising gatene. men før de kan bli utbredt, bilprodusenter må løse en umulig etiske dilemma av algoritmisk moral. Fra Oktober 2015…

Når det kommer til bilbransjen, selvkjørende biler er alle raseri. Standard funksjoner på mange vanlige biler inkluderer intelligent cruise control, parallell parkering-programmer, og til og med automatisk forbikjøring—funksjoner som gjør at du kan lene deg tilbake, om enn litt uneasily, og la datamaskinen gjøre kjøringen.

Så det vil ikke komme som noen overraskelse at mange bilprodusenter har begynt å tenke på biler som tar kjører ut av hendene sammen (se “Drivere Trykk Teslas Autopilot Utover Sine Evner”). Disse bilene vil være sikrere, renere og mer drivstoff-effektive enn manuelle motparter. Men de kan aldri være helt sikker.

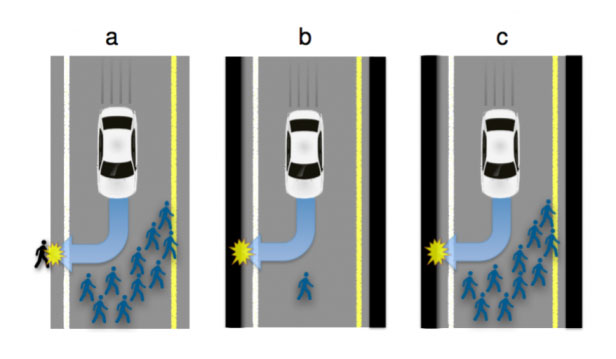

Og det reiser noen vanskelige spørsmål. Hvordan bør bilen være programmert til å handle i tilfelle av en uunngåelig ulykke? Bør det minimere tap av liv, selv om det betyr å ofre beboerne, eller skal den beskytte beboerne på alle kostnader? Skulle velge mellom disse ytterpunktene tilfeldig? (Se også “Hvordan å Hjelpe selvkjørende Biler Foreta Etiske Beslutninger.”)

Svarene på disse etiske spørsmålene er viktige fordi de kan ha en stor innvirkning på vei selvkjørende biler er akseptert i samfunnet. Hvem ville kjøpe en bil som er programmert til å ofre eieren?

Så kan vitenskapen hjelpe?

Fortsettelse…