Kontroversen om Project Maven visar att avdelningen har ett allvarligt förtroendeproblem. Detta är ett försök att fixa det.

Av

16 november 2021

Ms Tech | Getty

Ms Tech | Getty

När Google-anställda 2018 fick reda på deras företags engagemang i Project Maven, en kontroversiell amerikansk militär insats för att utveckla AI för att analysera övervakningsvideo, var de inte nöjda. Tusentals protesterade. “Vi anser att Google inte bör vara i krigsbranschen”, skrev de i ett brev till företagets ledning. Ett dussintal anställda sa upp sig. Google förnyade inte kontraktet 2019.

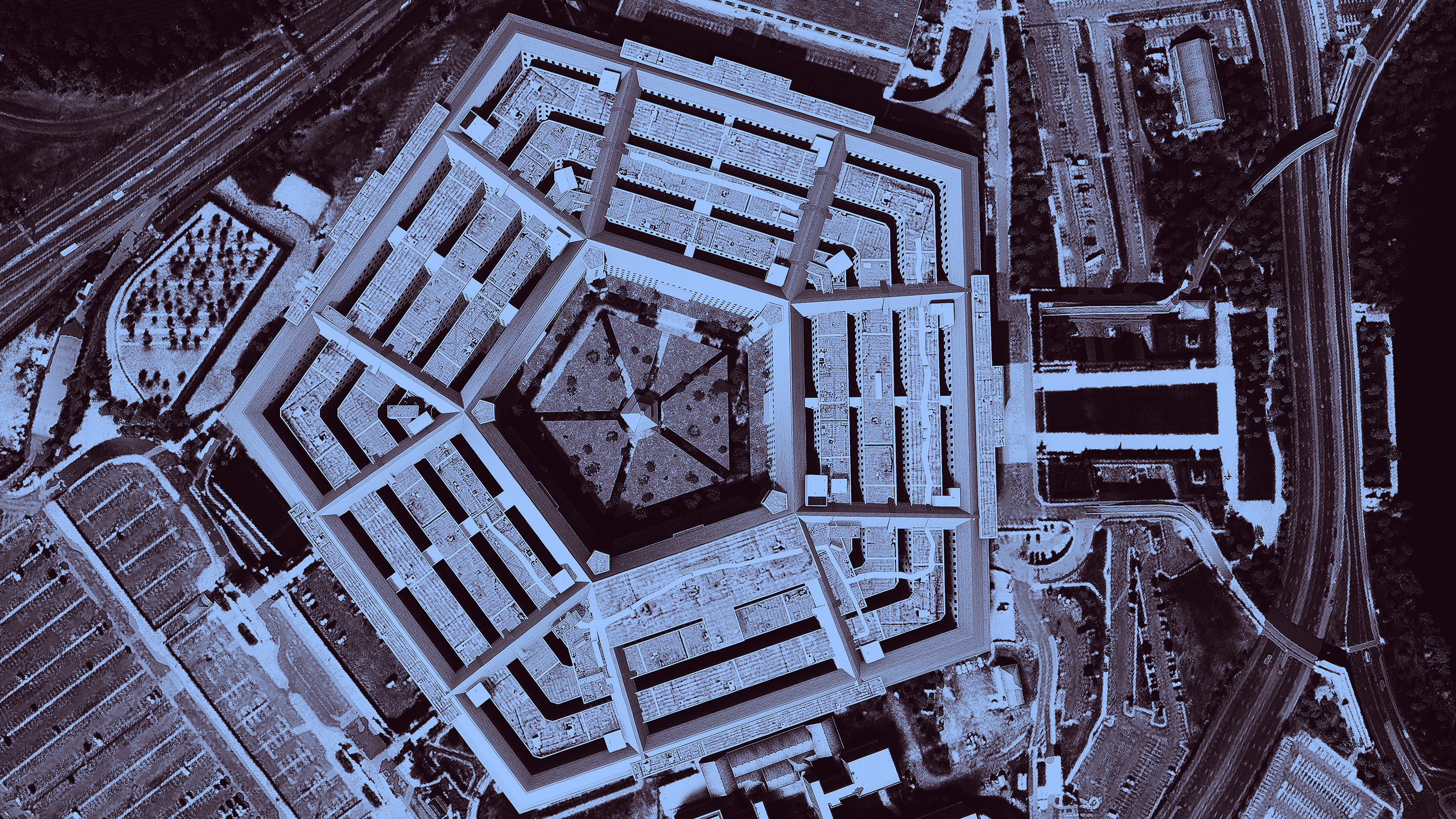

Project Maven existerar fortfarande, och andra teknikföretag, inklusive Amazon och Microsoft, har sedan dess tagit Googles plats. Ändå vet det amerikanska försvarsdepartementet att det har ett förtroendeproblem. Det är något den måste ta itu med för att behålla tillgången till den senaste tekniken, särskilt AI – vilket kommer att kräva samarbete med Big Tech och andra icke-militära organisationer.

Relaterad historia

för att öka sina riktlinjer för amerikanska myndigheters tech-teknik användning av teknik för ansiktsigenkänning

för att öka sina riktlinjer för amerikanska myndigheters tech-teknik användning av teknik för ansiktsigenkänning

En ny undersökning visar att de kontroversiella systemen är redo att spela en ännu större roll i federala affärer.

I ett försök att främja transparens har Defense Innovation Unit, som tilldelar DoD-kontrakt till företag, släppt vad den kallar riktlinjer för “ansvarig artificiell intelligens” som den kommer att kräva att tredjepartsutvecklare använder när de bygger AI för militären, oavsett om den AI är för ett HR-system eller måligenkänning.

Riktlinjerna tillhandahåller en steg-för-steg-process för företag att följa under planering, utveckling och driftsättning. De inkluderar procedurer för att identifiera vem som kan använda tekniken, vem som kan skadas av den, vilka dessa skador kan vara och hur de kan undvikas – både innan systemet byggs och när det är igång.

< p>“Det finns inga andra riktlinjer som finns, varken inom DoD eller, ärligt talat, USA:s regering, som går in på denna detaljnivå”, säger Bryce Goodman vid Defense Innovation Unit, som var medförfattare till riktlinjerna.

Arbetet kan förändra hur AI utvecklas av den amerikanska regeringen, om DoD:s riktlinjer antas eller anpassas av andra avdelningar. Goodman säger att han och hans kollegor har gett dem till NOAA och Department of Transportation och pratar med etikgrupper inom justitiedepartementet, General Services Administration och IRS.