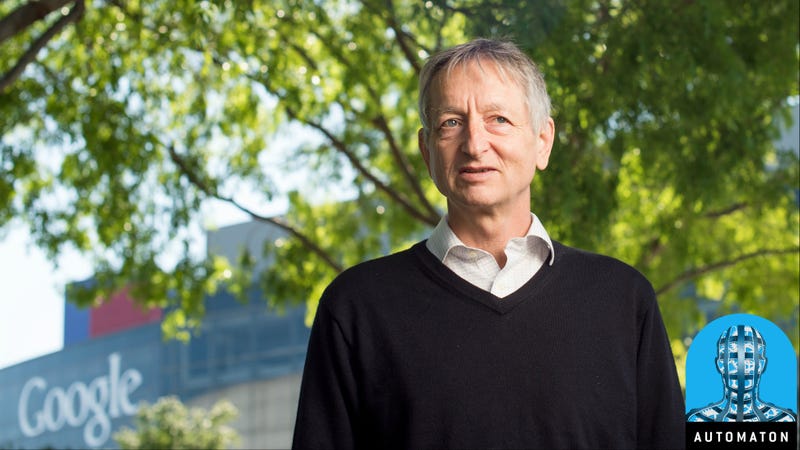

Informatico Geoffrey Hinton, che studia le reti neurali utilizzate in applicazioni di intelligenza artificiale, pone al di Google a Mountain View, in California, sede mercoledì 25 Marzo 2015.Foto: Noè Berger (AP)

Informatico Geoffrey Hinton, che studia le reti neurali utilizzate in applicazioni di intelligenza artificiale, pone al di Google a Mountain View, in California, sede mercoledì 25 Marzo 2015.Foto: Noè Berger (AP)

Martin Ford fatto le onde con il suo 2015 libro, Rise of the Robots, che descrive le numerose accelerare le tendenze di automazione e come previsto l’impatto di business e, soprattutto, l’occupazione. Per il suo prossimo libro, Architetti di Intelligence: La Verità Sull’intelligenza artificiale dal Popolo, egli, bene, cerca di affinare il proprio su quello che il sottotitolo viene descritto. E ‘ imbottito con interviste in profondità con i più grandi nomi AI. Uno di questi è di Geoffrey Hinton. Attualmente è professore di computer science presso l’Università di Toronto e una parte di Google Brain project, Hinton è considerato da molti il suo campo per essere il ‘padrino di apprendimento profondo,’ a causa del suo lavoro pionieristico in reti neurali artificiali.

Di seguito, presentiamo un estratto da Architetti di Intelligenza in cui il padrino di apprendimento profondo ritiene economica e sociale ramificazioni dell’ascendente sistemi ha aperto la strada. Godere. — Brian Mercante

MARTIN FORD: parliamo di potenziali rischi di AI. Una sfida particolare che ho scritto su è il potenziale impatto sul mercato del lavoro e l’economia. Pensi che tutto questo potrebbe causare una nuova Rivoluzione Industriale e trasformare completamente il mercato del lavoro? Se è così, è qualcosa di cui dobbiamo preoccuparci, o è un’altra cosa, che forse è pubblicizzato?

GEOFFREY HINTON: Se è possibile aumentare notevolmente la produttività e rendere più chicche di andare in giro, che dovrebbe essere una buona cosa. Se non si rivelasse essere una buona cosa dipende interamente sul sistema sociale, e non dipende affatto dalla tecnologia. La gente sta guardando la tecnologia come se i progressi tecnologici sono un problema. Il problema è che nei sistemi sociali, e se stiamo andando ad avere un sistema sociale che condivide abbastanza, o uno che si concentra tutto il miglioramento rispetto al 1% e si tratta il resto del popolo come sporco. Nulla a che fare con la tecnologia.

MARTIN FORD: il problema nasce, però, perché un sacco di posti di lavoro potrebbe essere eliminato—in particolare, i lavori che sono prevedibili e facilmente automatizzato. Una risposta sociale che è un reddito di base. È una cosa che si d’accordo?

GEOFFREY HINTON: Sì, penso che un reddito di base, è un idea molto sensibile.

MARTIN FORD: si pensa, poi, che le risposte politiche necessarie per affrontare questo?

Alcune persone che dovremmo lasciarla giocare fuori, ma che forse è irresponsabile.

GEOFFREY HINTON: mi sono trasferito in Canada perché ha un alto tasso di imposizione e perché penso che le tasse fatto cose sono buone. Quello che i governi dovrebbero fare è mettere i meccanismi in modo che quando le persone agiscono nel proprio interesse, aiuta tutti. Alto livello di tassazione è un meccanismo di questo tipo: Quando la gente ottenere ricchi, tutti gli altri si fa aiutato dalle tasse. Sono certamente d’accordo che c’è un sacco di lavoro da fare nel fare in modo che AI benefici tutti.

MARTIN FORD: Cosa dire di altri rischi associati con l’AI, come weaponization?

GEOFFREY HINTON: Sì, sono preoccupato da alcune delle cose che il Presidente Putin ha detto di recente. Penso che la gente dovrebbe essere molto attiva nel cercare di ottenere la comunità internazionale per il trattamento di armi che possono uccidere le persone senza una persona in loop lo stesso trattamento di armi chimiche e armi di distruzione di massa.

MARTIN FORD: Sarebbe a favore di un qualche tipo di una moratoria su che tipo di ricerca e di sviluppo?

GEOFFREY HINTON: Tu non stai andando a ottenere una moratoria su che tipo di ricerca, proprio come non hai avuto una moratoria sullo sviluppo di agenti nervini, ma si dispone di meccanismi internazionali che hanno impedito loro di essere ampiamente utilizzato.

MARTIN FORD: per quanto riguarda gli altri rischi, oltre il militare l’uso di armi? Ci sono altri problemi, come la privacy e la trasparenza?

GEOFFREY HINTON: penso che si utilizza per manipolare le elezioni e a manipolare gli elettori è preoccupante. Cambridge Analytica è stato istituito da Bob Mercer che era una macchina di apprendimento della persona, e si è visto che la Cambridge Analytica fatto un sacco di danni. Dobbiamo prendere molto sul serio.

MARTIN FORD: pensate che c’è un posto per regolamento?

GEOFFREY HINTON: Sì, un sacco di regolamento. E ‘ una tematica molto interessante, ma io non sono un esperto su di esso, così non hanno molto da offrire.

MARTIN FORD: che Cosa circa il global corsa agli armamenti in generale? Pensi che sia importante che un paese non troppo lontano davanti agli altri?

GEOFFREY HINTON: di Cosa stai parlando è la politica globale. Per un lungo periodo di tempo, la gran Bretagna è una nazione dominante, e che essi non si comportano molto bene, e poi era l’America, e che essi non si comportano molto bene, e se diventa il Cinese, non mi aspetto che loro di comportarsi molto bene.

MARTIN FORD: pensi che si dovrebbe avere una qualche forma di politica industriale? Dovrebbero fare gli Stati Uniti e altri governi Occidentali focus su AI e di farne una priorità nazionale?

GEOFFREY HINTON: Ci sono enormi sviluppi tecnologici e paesi sarebbero pazzi a non provare a tenere il passo con quello, così, ovviamente, penso che ci dovrebbe essere un sacco di investimenti. Che sembra il senso comune per me.

MARTIN FORD: nel complesso, siete ottimisti? Pensi che il premio AI sono andando a compensare gli svantaggi?

GEOFFREY HINTON: spero che le soddisfazioni superano gli svantaggi, ma non so se lo faranno, e questo è un problema dei sistemi sociali, non con la tecnologia.

MARTIN FORD: C’è un enorme talento carenza di AI e di tutti assumere. C’è qualche consiglio daresti a un giovane che vuole entrare in questo campo, nulla che possa attirare più persone e permettere loro di diventare esperti nell’AI e nell’apprendimento profondo, che è in grado di offrire?

GEOFFREY HINTON: io sono preoccupato che potrebbe non essere abbastanza gente che critica delle nozioni di base. L’idea di Capsule per dire, forse alcuni modi di base stiamo facendo le cose non sono il modo migliore di fare le cose, e noi dovremmo lanciare una rete più grande. Dobbiamo pensare a delle alternative a base di ipotesi che stiamo facendo. Un pezzo di consiglio che vi diamo è che se si hanno intuizioni che ciò che le persone stanno facendo è sbagliato e che ci potrebbe essere qualcosa di meglio, è necessario seguire le vostre intuizioni.

Stai molto probabile che sia sbagliato, ma a meno che le persone a seguire le intuizioni quando hanno loro su come cambiare radicalmente le cose, stiamo andando a ottenere bloccato. Una preoccupazione è che penso che il più fertile fonte di realmente nuove idee per studenti di dottorato di essere ben consigliato in una università. Essi hanno la libertà di puri nuove idee, e si impara abbastanza in modo che essi non solo ripetendo la storia, e noi dobbiamo preservare. Gente che fa un master e poi dritto nel settore non stanno andando a venire con idee radicalmente nuove. Penso che avete bisogno di sedersi e pensare per un paio di anni

MARTIN FORD: sembra che Ci sia un hub di apprendimento profondo a coalescenza in Canada. È solo casuale, o c’è qualcosa di speciale in Canada, che ha contribuito con che?

GEOFFREY HINTON: Il Canadian Institute for Advanced Research (CIFAR) ha fornito finanziamenti per la ricerca di base nelle aree ad alto rischio, e che è stato molto importante. C’è anche un sacco di fortuna che sia Yann LeCun, che è stato brevemente la mia titolare di assegno di ricerca, e Yoshua Bengio erano anche in Canada. I tre di noi, potrebbe costituire una collaborazione che è stato molto proficuo, e il Canadian Institute for Advanced Research finanziato la collaborazione. Questo era un momento in cui tutti noi sarebbe stato un po ‘ isolato in un abbastanza ostile ambiente—ambiente per l’apprendimento profondo era piuttosto ostile fino a poco tempo fa—è stato molto utile avere questo finanziamento che ci ha permesso di trascorrere un sacco di tempo con l’altro in piccole riunioni, dove abbiamo potuto davvero condividere idee inedite.

Tratto con il permesso di Architetti di Intelligence: La Verità sull’IA le Persone di Costruzione da Martin Ford. Pubblicato da Packt Publishing Limited. Copyright (c) 2018. Tutti i diritti riservati. Questo libro è disponibile presso amazon.com.

Condividi Questa Storia