Omedelbart när Dr. Blake Richards hört talas om djupt lärande, han insåg att han stod inför inte bara med en metod som revolutionairy artificiell intelligens. Han insåg att titta på något grundläggande i den mänskliga hjärnan. Det var i början av 2000-talet, och Richards genomfört en kurs på Universitetet i Toronto tillsammans med Geoff Hinton. Att Hinton, som var en av skaparna av den algoritm, erövra världen, erbjuds att läsa introduktion till hans metod för undervisning inspirerad av den mänskliga hjärnan.

Nyckelorden här är “inspirerad av hjärnan.” Trots den fällande domen mot Richards, bet spelade mot honom. Den mänskliga hjärnan, som det visade sig, har viktiga funktioner, som är programmerbar i algoritmerna djupt lärande. På ytan dessa algoritmer bryter mot grundläggande biologiska fakta har redan bevisats av forskare.

Men vad händer om djupt lärande och hjärnan faktiskt är kompatibla?

Och nu, i en ny studie som publiceras i eLife, Richards, som arbetar med DeepMind, föreslagit en ny algoritm som bygger på biologiska struktur av nervceller i neocortex. Hjärnan, hjärnbarken, som är hem till den högsta kognitiva funktioner såsom tänkande, förutse och flexibelt tänkande.

Laget gick den artificiella neuroner i ett skiktat nätverk, och ställ in den uppgiften av den klassiska datorn vision är att identifiera handskrivna siffror.

Den nya algoritmen gjorde det bra. Men vad som är viktigare: han analyserade prover för utbildning, som gör algoritmer för djupt lärande, men var helt byggt på grundläggande biologi i hjärnan.

“Djupt lärande som är möjligt i en biologisk struktur”, konstaterade forskarna.

Eftersom det för närvarande den här modellen är en dator-versionen, Richards hoppas att stafettpinnen till experimentella forskare, som kan hjälpa dig att kontrollera om denna algoritm i en riktig hjärna.

Om Ja, kan data överföras till en dator forskare för att utveckla ett massivt parallella och effektiva algoritmer som kommer att arbeta på våra bilar. Detta är det första steget till en sammanslagning av två fält i “god cirkel dance” för upptäckt och innovation.

Sökandet efter en syndabock

Även om du har förmodligen hört att artificiell intelligens har nyligen slagit de bästa av de bästa go, du är inte troligt att veta exakt hur de algoritmer som arbetar utifrån denna artificiella intelligens.

I ett nötskal, djupt lärande som bygger på ett artificiellt neuralt nätverk med en virtuell “neuroner”. Som högsta skyskrapa, nätverket är strukturerade i en hierarki: låg-nivå nervceller bearbetning av indata, till exempel, horisontella eller vertikala streck som bildar siffran 4, och nervceller behandlas med en hög nivå abstrakta aspekter av nummer 4.

Att träna nätverket, kan du ge henne några exempel av vad du letar efter. Signalen sprids via nätverket (upp trapporna i byggnaden), och varje neuron är att försöka uppfatta något som är grundläggande i arbetet för Kvartetten.

Som barn lära sig något nytt, det första nätverket är inte spackling mycket bra. Hon ger allt för att, enligt henne, ser ut som ett nummer fyra och få i den anda av Picasso.

Men det är historien om lärande: algoritmen jämför resultatet med den perfekta ingången och beräknar skillnaden mellan dem (läs: fel). Felet är “tillbaka förökas” genom nätverk, undervisning varje neuron, säger de, är inte vad du letar efter, ser bättre ut.

Efter miljontals exempel och repetitioner, nätverket börjar att fungera perfekt.

Fel signal är oerhört viktigt för lärande. Utan en effektiv “back-propagation” nätverk kommer inte att veta vilka nervceller som är fel. I jakten på en syndabock artificiell intelligens förbättrar sig själv.

Hjärnan gör det också. Men hur? Vi har ingen aning.

Biologisk återvändsgränd

Det självklara: en lösning med djup utbildning som inte fungerar.

Tillbaka förökning av fel är en oerhört viktig funktion. Det kräver en viss infrastruktur för att fungera korrekt.

För det första, varje neuron i nätverket som ska ta emot fel anmälan. Men i hjärnan nervceller är ansluten endast med flera partners på nedströms (om den inte är ansluten). För att minska spridningen arbetat i hjärnan, nervceller på de första nivåerna bör uppfatta informationen från de miljarder anslutningar i fallande kanaler — och det är biologiskt omöjligt.

Och medan vissa djupt lärande algoritmer anpassa lokal form av fel back-propagation är i huvudsak mellan nervceller — det kräver att anslutningen är framåt och bakåt är symmetrisk. I synapserna i hjärnan detta inte händer nästan aldrig.

Mer moderna algoritmer anpassa en annan strategi, att genomföra en separat feedback banan, vilket hjälper till att nervceller hitta fel och lokalt. Trots att det är biologiskt möjligt, hjärnan inte har ett separat nätverk för att söka efter syndabockar.

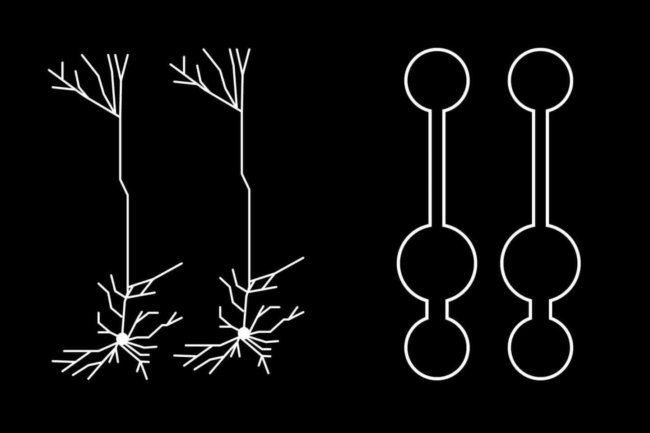

Men det har också nervceller med komplexa strukturer, i motsats till den homogena “bollar”, som för närvarande används i djup inlärning.

Förgrenade nätverk

Forskare drar inspiration från pyramidala celler som befolkar cortex i den mänskliga hjärnan.

“De flesta av dessa neuroner är formade som träd, deras rötter går djupt in i hjärnan, och “grenarna” komma upp till ytan, säger Richards. “Intressant, rötter få lite input set och grenar de andra.”

Märkligt, men strukturen av nervceller ofta är “exakt hur man” för att effektivt lösa beräkningsproblem. Ta, till exempel, bearbetning av känslor: i botten av pyramidala nervceller som ligger där du behöver för att komma touch input, och topparna är väl positionerat för överföringsfel genom feedback.

Kan detta komplex struktur för att vara en evolutionär lösning för att bekämpa fel signaler?

Forskare har skapat en mångbottnad neurala nätverk baserat på tidigare algoritmer. Men i stället för homogena nervceller de liknar nervceller i mitt lager inklämt mellan input och output — som liknar den äkta varan. Lärande handskrivna siffror, algoritmen visade sig vara mycket bättre än den enda nätverk, trots avsaknad av klassisk fel back-propagation. Cellens struktur kunde identifiera felet. Sedan, vid rätt tidpunkt, neuron kombinerar både en källa av information för att hitta de bästa lösningarna.

Detta har en biologisk grund: forskare har länge vetat att de ingående grenarna av neuron genomföra lokala beräkningar som kan integreras med signal back-propagation från produktionen grenar. Men vi vet inte om hjärnan fungerar i verkligheten, därför Richards gav neuroforskare att ta reda på.

Dessutom, detta nätverk hanterar ett problem som liknar den traditionella metoden för djupt lärande att läsa: använder en flerskiktade strukturen för att utvinna allt mer abstrakta idéer om att varje nummer.

“Det är en funktion av djup lärande”, förklarar författarna.

Djupt lärande hjärnan

Utan tvekan, denna historia kommer att bli fler vändningar eftersom datorn forskare göra mer och mer biologisk detalj i de algoritmer som AI. Richards och hans team överväga automatisk funktion från toppen och nedåt, när signalerna från högre nivåer som direkt påverkar hur lägre nivåer svara på ingång.

Feedback från övre nivåer som inte bara förbättrar signalering av fel; det kan också uppmuntra nervceller till låg-nivå som behandling för att fungera “bättre” i realtid, säger Richards. Tills nätverket har överträffat andra icke-biologiska nätverk djupt lärande. Men det spelar ingen roll.

“Djupt lärande har haft en enorm inverkan på AI, men dess inverkan på neurovetenskap var begränsad”, säger författarna av studien. Nu har forskare kommer att få tillfälle att genomföra ett pilotprojekt för att testa och lära är den struktur av nervceller i basen för den naturliga algoritm för djupt lärande. Kanske i nästa tio år kommer att börja ett ömsesidigt givande utbyte av data mellan forskare och forskare inom artificiell intelligens.

Har vår hjärna djupt lärande för att förstå världen?

Ilya Hel