Millionen von Jungen Spielern gewohnt sind, den «bösen Jungs.» Aber oft sind Sie die schlimmsten Feinde – es Kolleginnen und Kollegen auf dem Spiel. Auf vielen Websites von Online-spielen toben Belästigung, Einschüchterung. Einige drohen sogar mit dem Tod. Dies ist ein häufiges Problem für viele Online-communities, wie Twitter, YouTube und Facebook.

Wie Unruhestifter trennen? Seit einigen Jahren Riot Games, die produziert unglaublich beliebte Spiel League of Legends, experimentiert mit künstlichem Intellekt und Werkzeugen prädiktive Analyse zu bringen, Online-Trollen und wieder den Geist des Spiels. Die Spieler in der Liga zum aufspüren von «den Schafen» und entscheiden über die notwendigen Maßnahmen. Ihre Urteile werden ebenfalls von einem Programm mit künstlicher Intelligenz, die im Laufe der Zeit in der Lage, weitgehend selbstständig zu identifizieren, zu erziehen, umerziehen und Spieler zu disziplinieren.

Riot Games erforschen, wie können саморегулироваться großes heterogen und Online-Community. Dieses wissen kann verwendet werden, auf unterschiedliche Weise: zum Beispiel, um Teamarbeit zu tun effizienter, je nach Persönlichkeitstypen oder um besser zu verstehen, wie unsere Online-Identität reflektieren die realen.

«Früher haben wir geglaubt, dass die Online-Spiele und destruktives Verhalten sind untrennbar miteinander verbunden», erklärt Jeffrey Lin (Jeffrey Lin, Chief game Designer von sozialen Systemen in der von Riot Games. “Aber jetzt wissen wir, dass die Mehrheit der Spieler hält ein solches Verhalten ekelhaft. Wir wollen eine kulturelle Umgebung, die zeigt, was ist ein gutes Spiel.”

Dieses Ziel zu erreichen ist nicht einfach. Riot Games immer Schweines, das Verhalten der Spieler – hat verboten, Verfolgungen und Manifestationen des Rassismus, der Sexismus, der kulturellen Diskriminierung, Homophobie. Jedoch, im Fall von League of Legends in der täglichen Aktivität nicht erlaubte überwachung der Umsetzung der Regeln, die mit traditionellen Methoden und Aufwand der Moderatoren. Mehr als 27 Millionen Menschen spielen mindestens ein Spiel League of Legends pro Tag und in der Hauptverkehrszeit kann gleichzeitig spielen mehr als 7,5 Millionen Spieler.

Dies ist einer der Gründe, warum Riot Games weist große Ressourcen auf diese Initiative. Jeffrey Lin, dessen Promotion in der kognitiven Neurologie, arbeitet Ihr gemeinsam mit anderen Wissenschaftlern, die sich schwerpunktmäßig auf die Arbeit des Gehirns. Erstellen Sie auch die technische Plattform war die Aufgabe nicht aus den Lungen. Um petabytes von anonymen Daten in nützliche Erkenntnisse über das Verhalten der Nutzer, benötigt ein Förderband Daten. Team Lina auch mit Designern zusammengearbeitet, um sicherzustellen, dass Ihre Arbeit keinen Einfluss auf das Spiel-interface.

Phase 1: Das Tribunal

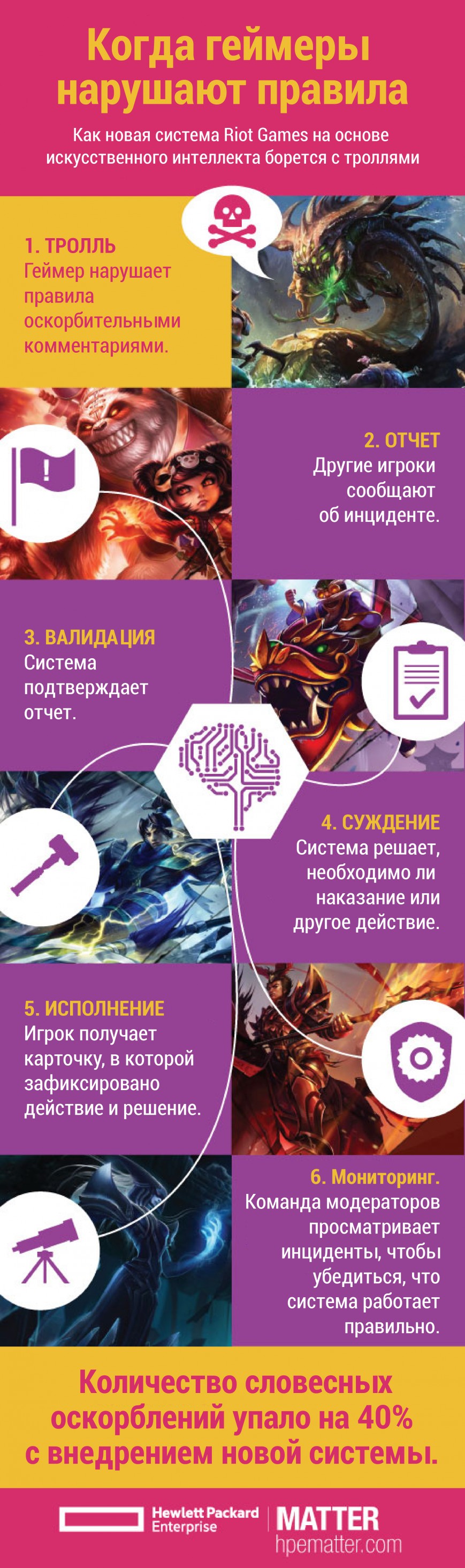

In der ersten Phase des Programms, die begann im Jahr 2011, die Spieler berichteten über Verstöße gegen die Regeln von anderen Spielern. Diese Berichte kamen in ein öffentliches Registrierungssystem, das so genannte Tribunal, in dem die betrachteten Vorfälle einzelne Spieler. Jeder Fall in der Regel enthalten die Korrespondenz im Chat, Statistiken und Spiele und sonstige Informationen, auf deren Grundlage der Kommentator entschieden, zu bestrafen oder zu vergeben Angeklagten. Die Mehrzahl der Fälle, laut Lina, die auftraten, wenn ein Spieler mit normalem Verhalten gab es Probleme und Sie sind einfach выплескивали Sie im Spiel.

Die Spieler bewerteten die negativen Kontext des Kommentars, um abzustimmen, wie viel schwerer muss Strafe sein. Stufen waren unterschiedlich: von E-Mail-Adresse, bescheiden erinnernd über den Verstoß der Regeln, bis langfristige Sperrung deines Accounts. Nachdem im System sammelte Millionen von Stimmen, Riot Games Schloss das Tribunal im Jahr 2014 und dem Beginn der arbeiten an dem System mit künstlicher Intelligenz.

«Es gibt zwei Möglichkeiten zur Bewältigung von Problemen dieser Größenordnung, und wir setzen beide,» sagt Eric Roberts, head of Communications bei Riot Games. «Zuerst, lassen Sie die Werkzeuge in die Hände der Gemeinschaft und nach – Trainees bauen Sie Systeme, die verwendet werden Maßstab eingehenden Daten, um mit dem Problem zu kämpfen.»

Phase 2: künstliche Intelligenz

Letztes Jahr Riot Games hat begonnen testen Sie Ihr System «Umerziehung Spieler», die schneller Feedback gibt und teilweise automatisiert. System darauf konfiguriert ist, die Identifizierung von Beschimpfungen, kann senden Spieler spezielle Karten, die Beweise für Ihre falschen Verhaltensweisen. Das Team von Linas selbst habe einige tausend der ersten Fälle, um sicherzustellen, dass alles funktioniert, und die Ergebnisse waren erstaunlich: die Zahl der Beschimpfungen fiel auf 40 Prozent von dem Moment an, wenn der Gerichtshof und starteten ein neues Programm mit künstlicher Intelligenz.

Lin bin sicher, dass viele Spiele-Entwickler werden Erben dieses Modell – der Verbindung von kognitiven Forschung, um das Spiel zu verbessern, und die Einstellung dazu interdisziplinäre Teams. «Wir перевоспитываем Spieler die Tatsache, dass geben Ihnen Feedback und Regen die Diskussion in der Gemeinschaft,» sagt Lin. «Wir haben gezeigt, dass wir die Kultur ändern, mit den richtigen Werkzeugen.»

Um zu erfahren, wie Big data, Automatisierung und künstliche Intelligenz Zukunft ändern, laden Sie den Bericht HPE “Big Data in 2016”