Et eksperiment ved Universitetet i Washington forskere er å sette scenen for fremskritt i sinnet lesing teknologi. Ved hjelp av hjernen implantater og sofistikert programvare, forskere nå kan forutsi hva deres motiver er å se med forbløffende hastighet og nøyaktighet.

Muligheten til å vise et to-dimensjonalt bilde på en side eller skjermen, og deretter forvandle bildet til noe våre sinn kan umiddelbart gjenkjenne, er en nevrologisk prosess som forblir mystisk for forskere. For å lære mer om hvordan hjernen vår utføre denne oppgaven—og for å se om datamaskiner kan samle inn og forutsi hva en person er å se i sanntid—et forskerteam ledet av University of Washington hjerneforsker Rajesh Rao og nevrokirurg Jeff Ojermann vist at det er mulig å dekode menneskelige hjernen signaler på nesten hastighet oppfatninger. Detaljene i deres arbeid kan bli funnet i en ny artikkel i PLOS Beregningsorientert Biologi.

Laget søkte hjelp av sju pasienter som gjennomgår behandling for epilepsi. Medisiner ikke hjelper lindre beslag, slik at disse pasientene ble gitt midlertidig hjernen implantater, og elektrodene ble brukt til å finne de sentrale punktene i sine anfall. UW forskere så på dette som en mulighet til å utføre sine eksperimenter. “De skulle få elektrodene uansett hva,” bemerket Ojermann i en UW NewsBeat artikkelen. “Vi var bare å gi dem flere oppgaver å gjøre i løpet av sykehusoppholdet, mens de ellers er det bare å vente.”

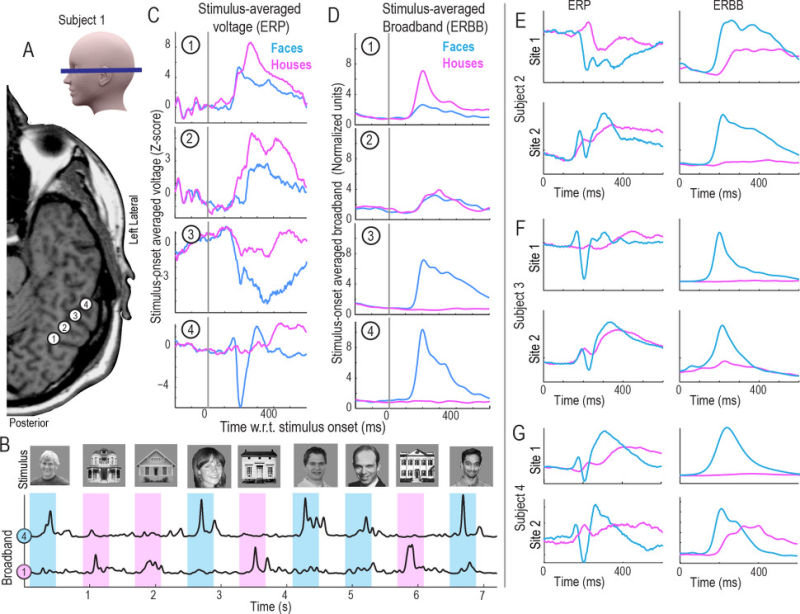

Pasienter ble vist en tilfeldig sekvens av bilder—bilder av ansikter, hus og tomt grå skjermer—på dataskjermer i korte trekk 400 millisekund intervaller. Deres spesifikke oppgave var å se på et bilde av en opp-ned hus.

Sponset

Ansiktet og hus diskriminering oppgave. Kreditt: Kai J. Miller et al., 2016/PLOS Beregningsorientert Biologi

På samme tid, elektroder i hjernen deres var koblet til programvare som hentet to forskjellige hjernen signal egenskaper, nemlig “hendelse knyttet potensialer” (når massive grupper av nerveceller samtidig lyser opp i respons til et bilde) og “bredbånd ” spectral” endringer (signaler som lurer når du viser et bilde).

Som bildene flickered på skjermen, en datamaskin samplet og digitalisert innkommende hjernens signaler til en verdi av 1.000 ganger per sekund. Denne løsningen tillatt programvaren for å finne ut hvilken kombinasjon av elektrode steder og signaler best korrelert til hva pasientene var å se. “Vi fikk forskjellige svar fra forskjellige (elektrode) steder; noen var følsomme for ansikter og noen var sensitive til hus,” sa Rao.

Etter trening programvaren, forskere utsatte pasienter til et helt nytt sett av bilder. Uten tidligere eksponering for disse nye bilder, maskinen var i stand til å forutsi med 96 prosent nøyaktighet når en test motivet var å se et hus, et ansikt eller et grått skjermbilde. Og det gjorde det på nesten hastighet oppfatninger.

Denne kompetansen bare skjedde når datamaskinen vurdert både event-relatert potensialer og bredbånd endringer, som som er oppgitt i undersøkelsen, tyder det på at “de tar forskjellige og komplementære aspekter av faget er perseptuell stat.”Så når det gjelder å forstå hvordan en person oppfatter et komplekst visuelt objekt, er det viktig å vurdere den “globale bildet” av store nevrale nettverk.

Mens interessant, resultatene av studien er svært begrenset. En sann test av systemet ville være å se om det kunne lære et mye større sett av bilder, inkludert forskjellige kategorier. Det er ikke umiddelbart opplagt, for eksempel, hvis datamaskinen kan se om en pasient var å vise ansiktet på et menneske eller en hund.

Når raffinerte, men denne typen av hjernen dekoding kan brukes til å bygge kommunikasjon mekanismer for “locked-in” pasienter som er lammet eller har hatt et hjerneslag. Denne teknikken kan også hjelpe med hjernen kartlegging, slik at nevrologer å identifisere steder i hjernen som er ansvarlig for visse typer av informasjon i sanntid.

[PLOS Beregningsorientert Biologi]

Øverste bilde: Kai Miller og Brian Donohue