Bild: AP Photo/Paul Sakuma

Bild: AP Photo/Paul Sakuma

Facebook hat ein problem. Nicht das, in dem Sie zugelassen sind, um ein Sprachrohr für propaganda und psy-ops. Oder der eine, wo Sie narced auf at-risk-teens. Nein, die heutige news bezieht sich darauf, wie die sozialen riesigen/massiven Daten-Sammlung-Schema hat (zunehmend) zu einem unwilligen Plattform für Anwender von broadcast-Gewaltverbrechen, sexuelle Handlungen, Ausbeutung von Kindern, und Selbstmord.

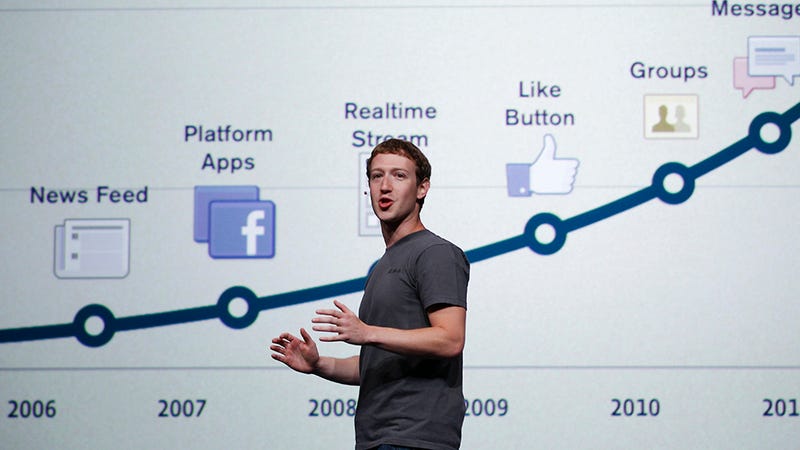

In einem früheren post heute, Mark Zuckerberg versprach, dass im nächsten Jahr, Facebook wird “hinzufügen 3.000 Menschen auf unserer community-operations-team rund um die Welt—auf der Oberseite der 4500, die wir heute haben—zu überprüfen, die Millionen von Berichte, die wir bekommen jede Woche, und verbessern Sie den Prozess, es zu tun schnell.” Der 32-jährige Firmenchef versprach auch der Bau von zusätzlichen reporting-tools, so dass Facebook-Nutzer besser helfen können die Unternehmen unter sich offensiv videos.

Es Gesicht, es ist löblich, Facebook würde dieses Problem angehen, indem Sie effektiv eine Verdoppelung der Menschen, die ops-team, vor allem, da es einige Hinweise darauf, Selbstmorden führen können, um eine “Ansteckung” der spätere Selbstmörder. Merklich abwesend in Zuckerberg ‘ s post, allerdings werden keine konkreten Angaben bezüglich der Beschäftigung, der Ausbildung und der Unterstützung dieser 3000 neue team-Mitglieder erhalten.

Die Berichterstattung über die Jahre hat gezeigt, dass viele der größten Unternehmen lagern Ihre MODERATIONS-teams, die Vermietung, niedrig bezahlte internationale Arbeiter—, die möglicherweise nicht über intime wissen über UNS soziale Sitten—Sicht die schlechteste Beiträge, Tag ein, Tag aus. Anzeigen von Morden und Selbstmorden für Monate oder Jahre am Ende kann die Ursache für Moderatoren zu entwickeln, die sehr Reale psychische Probleme, und einige ehemalige Moderatoren, die ich gesprochen habe, behaupten, Sie leiden unter PTSD nach Sichtung durch Funde von gewaltinhalten und Hassreden, oder sich selbst zum Gegenstand von Belästigungen durch die Nutzer.

Wenn, wie der Fall sein kann, der Arbeitnehmer Facebook will die mieten für den alleinigen Zweck der Beseitigung Ihrer am meisten aufwühlende videos sind Betriebe eher als Mitarbeiter, kann das Unternehmen nicht verpflichtet, Krankenversicherung, geschweige denn Beratung.

Facebook, wie viele soziale Netzwerke, hat zwei Sätze von Regeln: die breiten diejenigen Benutzer sind eingeweiht, und die körnige diejenigen Moderatoren erzählt werden, zu erzwingen. Deckkraft in der Politik und der Deckkraft in der Ausbildung führen, die auf Vorfälle wie Facebook der denkwürdigen Ausrutscher ziehen Sie den Pulitzer-preisgekrönte Foto aus dem Vietnam-Krieg, und nur wieder einmal öffentliche Empörung erreicht Ihren Höhepunkt. Grafik Mord und Selbstmord sind intuitiv aufwühlend, in jeder Kultur, aber jenseits dieser extremen Beispiele, die Ausbildung von Moderatoren, um wirksam zu sein, erfordert Zeit und Ressourcen, die meisten Unternehmen sind nicht daran interessiert, zu investieren in.

Ein Facebook-Sprecher gegenüber Gizmodo, dass Sie “nicht mehr alle details, Aktie über Mark’ s post zu übergeben, zu dieser Zeit,” aber, dass das Unternehmen bietet Unterstützung, um diese Beurteilung von der Plattform-Inhalte. Auf balance, weniger Möglichkeiten für die übertragung dieser Art von videos ist positiv, aber denken Sie daran, es ist wahrscheinlich auf die teure 7.500 anderen die psychische Gesundheit der Bevölkerung irgendwo auf halbem Weg auf der ganzen Welt.